A/B-тестирование лендингов — это не модный инструмент маркетолога-новичка и не способ закрыть скучающего product-овнера в роль «давайте просто проверим». Это единственный способ принимать решения о дизайне и тексте посадочной страницы, опираясь на реальное поведение пользователей, а не на мнение креативного директора, который вчера вернулся с конференции. За 12 лет работы в performance-маркетинге я видел сотни тестов: те, которые принесли клиентам десятки миллионов рублей дополнительной выручки, и те, которые сожгли бюджеты впустую из-за грубых ошибок в постановке. В этой статье — практическое руководство, как организовать сплит-тест лендинга, чтобы получить достоверные данные, а не красивую иллюзию роста конверсии.

Что такое A/B-тестирование лендингов и почему интуиция врёт чаще, чем кажется

A/B-тестирование (или сплит-тест) — это эксперимент, в котором вы одновременно показываете двум случайным группам пользователей две версии страницы: контрольную (A) и изменённую (B). Через определённое время вы сравниваете конверсии и определяете, какая версия работает лучше. Метод пришёл в маркетинг из медицины, где его используют для проверки эффективности лекарств: рандомизация участников исключает влияние посторонних факторов на результат.

Главная ценность сплит-теста не в том, что он помогает выбрать «правильный» цвет кнопки. Ценность — в том, что он защищает бизнес от дорогостоящих интуитивных решений. Маркетолог уверен, что новый заголовок сильнее. Дизайнер убеждён, что новая фотография в первом экране эмоциональнее. Собственник считает, что три тарифа продают лучше двух. Каждое из этих мнений — гипотеза, и каждое из них в 60–70% случаев оказывается ошибочным при проверке на реальном трафике.

Почему интуиция системно ошибается

Человеческий мозг устроен так, что хорошо распознаёт паттерны и плохо оценивает вероятности. Маркетолог, который видел десятки лендингов, уверен, что «знает», какой вариант сработает. На практике он прав примерно в трети случаев — что не сильно отличается от подбрасывания монетки. Причины две: во-первых, мы оцениваем дизайн с позиции эксперта, а решение принимает обычный пользователь с другим контекстом. Во-вторых, мы переоцениваем влияние эстетики и недооцениваем влияние ясности оффера.

Классический пример: команда вкладывает три недели в редизайн страницы — новая типографика, премиальные иллюстрации, плавные анимации. Запускают тест. Конверсия падает на 12%. Причина проста: красивая, но непонятная страница хуже понятной, но скучной. Пользователю важно за 5 секунд понять, что вы продаёте, кому это нужно и почему ему стоит оставить заявку. A/B-тест безжалостно вскрывает разрыв между нашими представлениями о красивом и тем, что реально работает.

Когда стоит делать A/B-тест, а когда — не стоит

Сплит-тестирование — мощный инструмент, но он работает только при определённых условиях. Запуск теста при недостаточном трафике или при отсутствии измеримой конверсии — это самый надёжный способ потратить недели работы и получить выводы, которые невозможно применить.

Минимальные условия для запуска теста

Перед тем как формулировать гипотезу, проверьте по чек-листу:

- На странице есть измеримая конверсия — клик по кнопке, отправка формы, переход в мессенджер. Без чёткой целевой метрики тест бессмысленен

- Конверсия фиксируется автоматически — через Метрику, Google Analytics, CRM. Ручной подсчёт «по звонкам в среду» не работает

- Трафик на страницу — от 1 000 уникальных посетителей в неделю. При меньшем трафике тест либо растянется на месяцы, либо не достигнет статистической значимости

- Базовая конверсия — не ниже 1%. На странице с конверсией 0,3% для значимого теста потребуются десятки тысяч посетителей

- Источник трафика стабилен. Если в середине теста маркетолог поменял креативы в Директе, аудитория сместится и тест испорчен

- Есть гипотеза с обоснованием, а не «давайте попробуем зелёную кнопку вместо синей»

Когда A/B-тест не нужен и даже вреден

Тестирование — не самоцель. В ряде ситуаций оно отнимает ресурсы и замедляет развитие проекта:

- На сайте грубые ошибки UX: форма не отправляется, кнопка скрыта за рекламным баннером, страница не открывается на мобильных. Сначала исправьте, потом тестируйте

- Трафика меньше 200 посетителей в день. Тест растянется на квартал, а бизнес-условия за это время изменятся

- Меняется визуальная мелочь: оттенок серого в подвале, шрифт в копирайте. Влияние на конверсию ниже статистической погрешности

- Сезонный пик (Чёрная пятница, новогодние праздники). Аудитория и поведение нестандартны, выводы не применимы вне сезона

- Только что запустили продукт и нет понимания, кто покупает. Сначала качественные интервью, потом количественные тесты

Минимально достаточный трафик и сроки: формула и калькулятор

Самая распространённая ошибка новичков — остановить тест после первых 100 переходов и заявить «вариант B победил с лифтом 35%». В реальности при таком объёме данных доверительный интервал настолько широк, что «победитель» с равной вероятностью может оказаться хуже исходника. Размер выборки — это не интуитивное число, а результат расчёта по формуле, в которую заложены три параметра.

Формула размера выборки

Минимальный размер выборки на каждую группу теста (n) рассчитывается по формуле:

n = 16 × p × (1 − p) / MDE²

Где p — текущая конверсия (например, 0,03 для 3%), MDE — минимальный детектируемый эффект (минимальный лифт, который вы хотите достоверно зафиксировать). Коэффициент 16 соответствует уровню доверия 95% и статистической мощности 80% — стандарту индустрии.

Пример расчёта. У вас лендинг с конверсией 3%, и вы хотите достоверно зафиксировать лифт от 20% (то есть рост с 3% до 3,6%). MDE в абсолютных значениях — 0,006. Подставляем: n = 16 × 0,03 × 0,97 / 0,006² = 12 933. Вам нужно по 12 933 посетителя в каждой группе, то есть 25 866 суммарно. При трафике 1 000 посетителей в день тест займёт 26 дней.

Таблица минимальных выборок

| Текущая конверсия | Желаемый лифт (MDE) | Размер выборки на группу | Срок при 500 посетителей/день суммарно |

| 1% | +50% (с 1% до 1,5%) | 15 840 | ~127 дней |

| 2% | +30% (с 2% до 2,6%) | 21 778 | ~174 дня |

| 3% | +20% (с 3% до 3,6%) | 12 933 | ~104 дня |

| 5% | +15% (с 5% до 5,75%) | 13 511 | ~108 дней |

| 5% | +25% (с 5% до 6,25%) | 4 864 | ~39 дней |

| 10% | +15% (с 10% до 11,5%) | 6 400 | ~51 день |

| 10% | +25% (с 10% до 12,5%) | 2 304 | ~18 дней |

Таблица: Минимальный размер выборки и срок A/B-теста в зависимости от конверсии и MDE

Из таблицы виден важный вывод: чем ниже базовая конверсия и чем меньший лифт вы хотите зафиксировать, тем дольше тест. Для лендингов с конверсией 1–2% реалистично тестировать только крупные изменения (новый оффер, перестроенная структура), а не вариации цвета кнопки.

Почему нельзя останавливать тест раньше срока

В первые дни теста показатели сильно скачут — это нормально и связано со случайной вариацией. Если вы каждое утро смотрите дашборд и закрываете тест в момент, когда вариант B обогнал A на 15%, вы попадаете в ловушку «peeking problem». Это статистическая ошибка: чем чаще вы проверяете промежуточные результаты, тем выше шанс ложноположительного вывода. На практике это означает, что 30–40% «победивших» тестов не воспроизводятся при повторном запуске.

Правило простое: до запуска посчитайте размер выборки, заложите срок не менее одной полной недели (чтобы попасть на все дни недели и сгладить недельный паттерн), и не смотрите промежуточные результаты до достижения расчётного объёма данных.

Гипотеза для A/B-теста: формула «Если изменить X, то метрика Y вырастет, потому что Z»

Хороший тест начинается с хорошей гипотезы. Плохая гипотеза звучит как «давайте попробуем другой заголовок». Хорошая гипотеза звучит так: «Если заменить заголовок “Профессиональное продвижение сайтов” на “Привлечём 100 клиентов в месяц из Яндекса за 3 месяца”, то конверсия в заявку вырастет на 15–25%, потому что новый заголовок содержит конкретный измеримый результат и снимает возражение “я не понимаю, что я получу”».

Структура работающей гипотезы

Каждая гипотеза для теста должна включать четыре элемента:

- Изменение (X) — что именно меняем. Чётко, конкретно, без двусмысленности

- Ожидаемая метрика (Y) — что должно измениться (конверсия в форму, в звонок, средний чек)

- Прогноз эффекта — на сколько вырастет метрика (диапазон в процентах)

- Обоснование (Z) — почему вы считаете, что это сработает (данные тепловой карты, опросы, исследования индустрии)

Если вы не можете заполнить пункт Z, гипотеза слабая. Это значит, что у вас нет понимания, какую проблему пользователя вы решаете изменением. Такие тесты обычно дают отрицательный или нулевой результат: вы потратили 3 недели и теперь знаете, что один из вариантов не работает, но не знаете, что попробовать дальше.

Источники для сильных гипотез

Гипотезы не рождаются в голове маркетолога — они извлекаются из данных. Основные источники:

- Веб-визор и тепловые карты Метрики — видно, на каких блоках пользователи задерживаются и где происходит отток

- Запись сессий (Метрика, Hotjar, Clarity) — реальное поведение конкретных людей, а не агрегированные цифры

- Глубинные интервью с клиентами — почему они выбрали вас, что чуть не остановило, какие альтернативы рассматривали

- Опросы посетителей через всплывающие виджеты («Что мешает оформить заказ?»)

- Анализ поисковых запросов в Метрике — какие формулировки приводят на страницу

- Конкурентный анализ — что работает у тех, кто растёт быстрее рынка

Что тестировать на лендинге: приоритет по влиянию на конверсию

За годы практики мы вывели порядок элементов лендинга по силе влияния на конверсию. Логика простая: тестировать сначала то, что даёт наибольший эффект. Цвет кнопки в 99% случаев влияет слабее, чем оффер в первом экране — поэтому начинать надо сверху.

Заголовок и подзаголовок

Заголовок — самый влиятельный элемент страницы. Пользователь решает, остаться или закрыть вкладку, за 3–5 секунд, и решение принимается на основе заголовка. Замена общего заголовка («Качественное SEO-продвижение») на конкретный обещающий результат («Поднимем сайт в ТОП-10 Яндекса за 4 месяца или вернём деньги») в наших тестах давала лифты от 18 до 47%.

Подзаголовок дополняет заголовок: уточняет, для кого предложение, или снимает основное возражение. Тестировать стоит и заголовок, и подзаголовок — но в одном тесте меняйте только один элемент, иначе непонятно, что повлияло на результат.

Оффер

Оффер — это суть сделки: что вы предлагаете, на каких условиях, что получит клиент. Сильный оффер отвечает на четыре вопроса: что (продукт), для кого (сегмент), за сколько (цена или модель ценообразования), почему сейчас (ограничение или бонус). Слабый оффер размыт и многословен.

В тестах работает усиление оффера за счёт гарантии («вернём деньги, если не получите N клиентов»), бонуса («плюс бесплатный аудит конкурентов в подарок»), ограничения («предложение действует до конца месяца»). Лифты от изменения оффера — обычно 10–30%.

CTA-кнопка: текст, цвет, расположение

Текст кнопки — недооценённый элемент. Замена «Отправить» на «Получить расчёт за 15 минут» в одном из наших тестов дала рост кликов на 31%. Принцип: на кнопке — конкретное действие и его выгода, а не абстрактный глагол.

Цвет кнопки влияет меньше, чем принято считать, но контраст с фоном — критичен. Если кнопка визуально сливается со страницей, её просто не замечают. Лифт от смены неконтрастной кнопки на контрастную — 5–15%.

Расположение кнопки: классическое правило «выше линии сгиба» работает не всегда. На длинных лендингах кнопка может располагаться 4–6 раз — после каждого смыслового блока. Тестируйте, сколько повторений CTA даёт максимальный эффект.

Структура и порядок блоков

Структура лендинга — это последовательность аргументов, которые ведут пользователя от внимания к действию. Изменение порядка блоков (например, «отзывы» перед «ценами» вместо после) может дать заметный эффект, особенно на длинных страницах с высокой долей дочитывания.

Тестировать стоит логику AIDA (внимание — интерес — желание — действие) против обратной структуры с социальными доказательствами в начале. Для разных индустрий работают разные подходы.

Изображение или видео в первом экране

Визуал первого экрана задаёт эмоциональный тон. Стоковые улыбающиеся менеджеры в наушниках уже не работают и часто проигрывают тестам с реальными фотографиями команды или продукта. Видео может работать сильнее статичной картинки, но только если оно автоматически воспроизводится без звука и иллюстрирует продукт, а не отвлекает.

Форма: количество полей и формат

Каждое лишнее поле в форме снижает конверсию в среднем на 5–10%. Если вы спрашиваете имя, телефон, email, должность, размер компании, бюджет и удобное время для звонка — половина потенциальных клиентов закроет форму. Тестируйте сокращение формы до 2–3 полей с возможностью уточнить детали при первом контакте менеджера.

Альтернативный формат — квиз. Замена «отправьте заявку и мы перезвоним» на квиз из 4–5 вопросов с расчётом стоимости в конце даёт лифт от 40 до 120% в нишах с непрозрачным ценообразованием.

Социальные доказательства

Логотипы клиентов, кейсы с цифрами, отзывы с фотографиями, рейтинги — каждый элемент социального доказательства снимает возражения. Тестировать стоит формат: видео-отзыв против текстового, кейс с цифрами против общей формулировки, логотип-стенка против скриншотов отзывов с площадок.

Цена и тарифная модель

Показывать цену или скрывать — частый предмет споров. В B2C для большинства категорий показывать цену выгоднее: пользователь не хочет звонить ради уточнения. В B2B и для услуг с проектным ценообразованием эффективнее показывать «от X ₽» или диапазон. Тестируйте также количество тарифов: три тарифа продают лучше одного, но четыре уже хуже трёх (классический парадокс выбора).

Что чаще всего побеждает в A/B-тестах: статистика по 50+ кейсам

Ниже — обобщённая статистика по тестам, которые мы проводили для клиентов агентства за последние 3 года, разбитая по типу изменения и индустрии. Цифры — медианный лифт конверсии в основной целевой действие (заявка, звонок, заказ).

| Тип изменения | Услуги B2B | E-commerce | Образование | Недвижимость |

| Конкретный заголовок с цифрой | +22% | +11% | +18% | +27% |

| Усиление оффера (гарантия) | +18% | +9% | +24% | +15% |

| Замена формы на квиз | +47% | +5% (нерелевантно) | +62% | +89% |

| Сокращение формы (5→3 поля) | +19% | +14% | +22% | +17% |

| CTA с конкретной выгодой | +13% | +8% | +11% | +9% |

| Видео в первом экране | +7% | +12% | +15% | +21% |

| Реальные фото вместо стока | +9% | +18% | +13% | +24% |

| Кейсы с цифрами | +16% | +4% | +19% | +11% |

| Цены на странице (вместо «по запросу») | −5% | +22% | +34% | −8% |

| Контрастная CTA-кнопка | +8% | +11% | +6% | +9% |

| Смена цвета кнопки (без изменения контраста) | +1,5% | +0,8% | +1,2% | +2,1% |

Таблица: Медианный лифт конверсии по типу изменения и индустрии (агрегированные данные 50+ тестов)

Главный вывод из таблицы: смена цвета кнопки практически никогда не даёт значимого эффекта. Реальные деньги приносят изменения оффера, формы, заголовка — то есть смыслового, а не визуального содержания страницы. Если у вас ограниченный ресурс на тесты — не тратьте его на цвета и шрифты.

Алгоритм проведения теста за 2–4 недели

Полный цикл одного A/B-теста на лендинге занимает от двух до четырёх недель в зависимости от объёма трафика. Алгоритм пошагово:

- День 1–2: формулировка гипотезы. Анализ данных Метрики, веб-визора, опросов. Формулировка гипотезы по схеме «Если X, то Y вырастет на N%, потому что Z»

- День 3–4: дизайн варианта B. Создание макета изменённой версии. Проверка корректности на разных устройствах

- День 5–6: техническая реализация. Подключение инструмента (VWO, Google Optimize-замена, кастомное решение), настройка целей, проверка работы счётчиков

- День 7: проверка корректности. Запуск на 10% трафика на 24 часа. Контроль, что обе версии видят разные пользователи и метрики корректно собираются

- День 8 — N: накопление данных. Тест работает в режиме «не подглядывать» до достижения расчётного объёма выборки. Минимум — одна полная неделя для попадания на все дни недели

- День N+1: анализ результатов. Расчёт статистической значимости, проверка по сегментам (мобильный/десктоп, источник трафика, география)

- День N+2: решение. Внедрение победившего варианта или закрытие теста с отрицательным результатом и формулировка следующей гипотезы

Статистическая значимость: p-value, доверительный интервал, MDE простыми словами

Без понимания базовой статистики невозможно принимать решения по результатам теста. Три ключевых понятия, которые должен знать каждый, кто запускает сплит-тесты.

P-value

P-value — это вероятность того, что наблюдаемая разница между вариантами возникла случайно, а не из-за реального эффекта изменения. В индустрии стандартом считается порог p < 0,05: если p-value меньше 0,05, разница признаётся статистически значимой. Это означает: вероятность ложноположительного вывода — менее 5%.

Простым языком: если калькулятор показывает p = 0,03, это значит «в 3 случаях из 100 такая разница могла возникнуть случайно». Если p = 0,18 — «в 18 случаях из 100 это случайность». Доверять выводу при p > 0,05 нельзя.

Доверительный интервал

Доверительный интервал показывает диапазон, в котором с заданной вероятностью (обычно 95%) находится истинное значение лифта конверсии. Если калькулятор выдаёт «лифт +12% (доверительный интервал: от +3% до +21%)», это значит: вы уверены на 95%, что реальный лифт где-то между 3% и 21%, и наиболее вероятная оценка — 12%.

Узкий доверительный интервал (например, от +10% до +14%) — признак надёжного результата. Широкий (от −2% до +26%) означает, что данных недостаточно и тест нужно продолжать.

MDE — минимальный детектируемый эффект

MDE — это самый маленький лифт, который ваш тест способен достоверно зафиксировать при текущем объёме выборки. Он рассчитывается до запуска теста и определяет, имеет ли смысл вообще запускать эксперимент.

Пример: вы предполагаете, что новый заголовок даст лифт около 10%. Расчёт MDE для имеющегося трафика показывает, что вы достоверно зафиксируете только лифт от 25%. Это значит: если реальный лифт окажется 8–15%, тест выдаст «нет статистически значимой разницы», и вы ошибочно сочтёте, что заголовок не сработал. Решение: либо увеличить трафик (запустить больше рекламы), либо удлинить срок теста, либо тестировать более крупные изменения.

Распространённые ошибки A/B-тестирования

Большинство тестов проваливаются не из-за плохих гипотез, а из-за технических и методологических ошибок. Топ-7 наиболее частых.

Тестирование слишком многих вариантов одновременно

Соблазн запустить сразу 4–5 вариантов главной страницы понятен: хочется быстро найти лучший. На практике это работает плохо: при 5 вариантах размер выборки на каждый должен быть таким же, как для двух вариантов, и общий объём данных растёт в 2,5 раза. При ограниченном трафике вы либо растягиваете тест на квартал, либо получаете недостоверные выводы по всем вариантам.

Правило: один тест — два варианта (A и B). Если хотите проверить три гипотезы — проведите три последовательных теста, а не один с тремя вариантами.

Преждевременная остановка теста

Уже разобрали выше — это статистическая ошибка peeking problem. Дополнительный риск: на коротких выборках сильнее проявляется эффект новизны. Пользователи, видящие новую версию страницы, кликают активнее просто потому, что она необычна. Через 2 недели эффект сходит на нет, и реальная конверсия возвращается к норме.

Игнорирование сегментов

Общий лифт +5% может скрывать радикально разные результаты по сегментам: мобильный +20%, десктоп −10%. Без сегментации вы внедряете изменение, которое улучшает мобильную конверсию, но рушит десктопную (или наоборот). Перед финальным решением всегда проверяйте результаты в разрезе устройств, источников трафика, новых vs возвращающихся пользователей.

Тестирование вторичных элементов

Тестирование цвета бордера у инпута, размера иконки в подвале, оттенка серого в фоне — это работа ради работы. Влияние таких изменений на конверсию исчезающе мало, и тест либо не достигнет значимости, либо покажет случайную разницу. Концентрируйтесь на элементах, которые видит каждый пользователь и которые влияют на принятие решения: первый экран, оффер, форма.

Изменение нескольких элементов одновременно

«Мы поменяли заголовок, картинку и кнопку — конверсия выросла на 18%». Что именно сработало? Непонятно. Если результат отрицательный — что нужно откатывать? Тоже непонятно. Принцип: один тест — одно изменение. Для проверки комбинированного эффекта существует MVT-тестирование (см. ниже).

Игнорирование сезонности и внешних факторов

Тест, запущенный за 2 недели до Чёрной пятницы и завершённый после неё, искажён сезонным всплеском конверсии. Аналогично: запуск крупной рекламной кампании, изменения в индексации поисковиков, новости индустрии — всё это влияет на трафик и поведение. Запускайте тесты в стабильные периоды, а если внешний фактор сработал в середине теста — лучше перезапустить.

Отсутствие защиты от загрязнения теста

Один и тот же пользователь должен видеть одну и ту же версию страницы во всех визитах. Если он зашёл сегодня и увидел A, а завтра увидел B, это искажает данные и злит пользователя. Все нормальные инструменты A/B-тестирования сохраняют выбор варианта в cookie или localStorage — проверяйте, что эта функция включена.

Многовариантное (MVT) и мультиармед бандит-тестирование

A/B-тест — базовый инструмент, но не единственный. Для специфических задач существуют более сложные подходы.

Многовариантное тестирование (MVT)

MVT (multivariate testing) проверяет одновременное влияние нескольких изменений. Например: 2 заголовка × 2 картинки × 2 текста кнопки = 8 комбинаций. Метод позволяет понять, какие сочетания работают синергично, а какие — конфликтуют.

Главный недостаток MVT — гигантская потребность в трафике. На 8 комбинаций нужно в 4 раза больше данных, чем на A/B-тест. Реалистично применять при трафике от 50 000 уникальных в неделю, что встречается у крупных e-commerce и медиа.

Мультиармед бандит-тестирование

Бандит-алгоритм (multi-armed bandit) — динамический подход, при котором система постепенно увеличивает долю трафика на лучше работающий вариант, не дожидаясь окончания теста. Это снижает «упущенную выгоду» в период тестирования: пользователи быстрее начинают видеть выигрышный вариант.

Бандит-подход хорош для коротких кампаний (промо к Чёрной пятнице) и для оптимизации заголовков в новостных лентах. Для классических лендингов он применяется реже, потому что не даёт чистых данных о значимости разницы — только адаптивно перераспределяет трафик.

Инструменты A/B-тестов: сравнение платформ

Google Optimize, главный бесплатный инструмент для сплит-тестов, был закрыт Google в сентябре 2023 года. С тех пор рынок переформатировался, и команды выбирают альтернативы исходя из бюджета и сложности задач.

| Инструмент | Цена (от) | Кому подходит | Особенности |

| VWO | от $199/мес | Средний и крупный бизнес | Мощный визуальный редактор, тепловые карты, запись сессий, MVT |

| AB Tasty | по запросу | Enterprise, e-commerce | Персонализация, интеграция с CDP, AI-рекомендации |

| Convertize | от $59/мес | Малый и средний бизнес | Простой интерфейс, фокус на e-commerce, шаблоны для нейромаркетинга |

| GrowthBook | бесплатно (open source) | Технические команды | Self-hosted, полный контроль над данными, требует разработки |

| Mindbox A/B | в составе платформы | Российский e-commerce | Часть CDP-платформы, тесты в email/push/сайте, интеграция с CRM |

| Optimizely | по запросу | Enterprise, корпорации | Лидер рынка, полная экосистема экспериментов, дорогой |

| Кастомное решение | стоимость разработки | Крупные продукты | Полная гибкость, но требует команды разработки и аналитиков |

Таблица: Сравнение инструментов A/B-тестирования в 2026 году

Для российских компаний, работающих без зарубежных платежей, оптимальные варианты — Mindbox (если уже используется как CDP), GrowthBook (для команд с разработчиками) или кастомная реализация на собственной аналитической платформе. Для команд с ограниченным бюджетом базовые тесты можно проводить через Яндекс Метрику + код для A/B-разделения трафика.

Кейс: рост конверсии лендинга строительной компании на 23% от теста заголовка

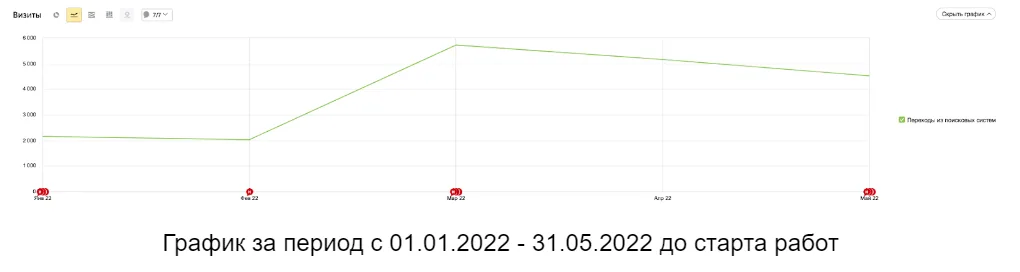

Клиент — компания, занимающаяся строительством каркасных домов в Подмосковье. Лендинг получал 4 000 уникальных посетителей в неделю с контекстной рекламы и SEO. Базовая конверсия в заявку — 4,2%.

Анализ веб-визора показал, что 47% пользователей закрывают страницу в течение первых 8 секунд. Тепловая карта первого экрана выявила слабую вовлечённость в области заголовка. Гипотеза: текущий заголовок «Строим каркасные дома по индивидуальным проектам» — слишком общий, не отвечает на главный вопрос пользователя «сколько это стоит и за сколько построите».

Вариант B: «Каркасный дом 120 м² под ключ за 4 месяца — от 2,8 млн ₽ с гарантией 10 лет». Изменение содержит конкретные параметры: площадь, срок, цена, гарантия. Подзаголовок остался прежним для чистоты теста.

Тест запустили на 50/50 трафика. Расчётный размер выборки на группу — 7 800 пользователей. Срок — 14 дней. По итогам:

- Вариант A: 8 124 посетителя, 341 заявка, конверсия 4,20%

- Вариант B: 8 067 посетителей, 417 заявок, конверсия 5,17%

- Лифт: +23,1%

- P-value: 0,008 (значимо)

- Доверительный интервал лифта: от +12% до +34%

Сегментация показала равномерный эффект на мобильном и десктопе, поэтому вариант B был внедрён на постоянной основе. В пересчёте на годовой трафик это дало клиенту дополнительно ~3 950 заявок в год при средней стоимости заявки 850 ₽ — экономия рекламного бюджета составила более 3,3 млн ₽.

A/B-тесты в email и push: специфика канала

Сплит-тестирование не ограничивается лендингами. В email-рассылках и push-уведомлениях оно применяется для оптимизации тем писем, времени отправки, формата контента и CTA-кнопок.

Что считать конверсией в email и push

В email-маркетинге обычно используют двухуровневую метрику: open rate (открываемость) и click-through rate (кликабельность). Тестирование темы письма влияет на open rate, но финальная цель — клики и конверсия на сайте. В push основная метрика — CTR, поскольку открытий как таковых нет.

Важная тонкость: для бизнеса значима не открываемость и не CTR сами по себе, а итоговая конверсия в целевое действие на сайте. Тема, которая поднимает open rate с 18% до 24%, но снижает конверсию из открытия в покупку с 3% до 1%, — проигрышная.

Размер выборки в email-тестах

Email-аудитория обычно меньше веб-трафика, поэтому требования к размеру выборки иные. Для значимого теста темы письма при базовом open rate 20% и желаемом MDE ±15% нужно по 4–5 тысяч получателей в каждой группе. Для рассылок размером менее 10 тысяч имеет смысл тестировать только на крупных гипотезах с MDE от 25%.

Защита от межкампанейских эффектов

Если в один день вы отправляете A/B-тест темы письма и параллельно запускаете промо в push, эффекты пересекутся: получатели обоих каналов увидят оба сообщения, и непонятно, что повлияло на конверсию. Правило: на период теста минимизируйте параллельные коммуникации в той же аудитории, либо разделяйте контрольные группы между каналами.

Связка A/B-тест + post-click аналитика для оценки реального impact на выручку

Рост конверсии в заявку — промежуточная метрика. Реальная цель бизнеса — выручка и прибыль. A/B-тест может показать рост заявок на 30%, но если эти заявки хуже квалифицированы, итоговая выручка может не вырасти, а упасть.

Сквозная аналитика для тестов

Для оценки реального impact лендинговых изменений необходимо связать данные A/B-теста с CRM. Технически это делается через UTM-метку или собственный параметр, который сохраняется в карточке лида: какой вариант страницы видел пользователь до отправки заявки.

Дальше в CRM можно посчитать по каждому варианту:

- Конверсию лида в квалифицированный (qualified lead)

- Конверсию в сделку (закрытую с оплатой)

- Средний чек по сделкам

- Совокупную выручку и прибыль

В наших проектах примерно в 15% случаев тесты с положительным лифтом конверсии давали отрицательный или нулевой эффект на выручку: рост числа заявок сопровождался падением их качества. Без сквозной аналитики такие случаи невозможно увидеть.

Метрика и Google Tag Manager для трекинга

Базовая настройка трекинга вариантов теста делается через Яндекс Метрику с использованием параметров визитов. На стороне инструмента A/B-тестирования настраивается отправка события «вариант показан» с параметром «A» или «B». В CRM или сквозной аналитике дальше эти параметры присоединяются к каждому лиду.

Чек-лист «Готов ли ваш A/B-тест»

Перед запуском любого сплит-теста пройдитесь по 10 пунктам. Если хотя бы один не выполнен — тест либо не даст достоверных результатов, либо приведёт к неправильным выводам.

- Гипотеза сформулирована по схеме «Если X, то Y вырастет на N%, потому что Z» — без интуитивных «давайте попробуем»

- Гипотеза опирается на данные: веб-визор, тепловая карта, опросы, интервью с клиентами

- Целевая метрика выбрана и измеряется автоматически через Метрику, GA или CRM

- Размер выборки рассчитан по формуле с учётом текущей конверсии и MDE

- Срок теста — не менее одной полной недели для попадания на все дни недели

- Два варианта (A и B), не больше — один тест меняет один элемент

- Технически реализована защита от загрязнения: один пользователь видит один вариант во всех визитах

- Запланирована проверка по сегментам: мобильный/десктоп, источник трафика, новые/возвращающиеся

- Период теста стабилен: нет сезонных пиков, крупных рекламных запусков, изменений в продукте

- Договорились не подглядывать в промежуточные результаты до достижения расчётного объёма данных

FAQ: ответы на частые вопросы по A/B-тестированию

Сколько должен длиться A/B-тест?

Минимум — одна полная неделя для нивелирования недельной сезонности. Максимум зависит от размера выборки: при 5 000 посетителей в неделю и базовой конверсии 3% для теста с MDE 20% потребуется около 2 недель, для MDE 10% — около 8 недель. Расчёт делайте до запуска по формуле n = 16 × p × (1−p) / MDE².

Можно ли запускать сплит-тест при 100 посетителях в день?

На таком трафике достоверный тест возможен только для радикальных изменений (полная переделка страницы, смена оффера) с MDE от 50%. Для тестирования отдельных элементов (заголовок, кнопка) трафика не хватит — лучше провести качественные исследования: интервью, юзабилити-тесты на 5–7 пользователях.

Что делать, если тест показал «нет статистически значимой разницы»?

Это нормальный результат, означающий, что изменение не дало эффекта в пределах вашего MDE. Внедрять вариант B не стоит — нет основания считать его лучше. Вернитесь к этапу гипотезы: либо ваше изменение реально не работает, либо вы тестировали слишком мелкий элемент. Сформулируйте новую гипотезу с обоснованием и проверьте её.

Можно ли тестировать одновременно несколько страниц сайта?

Можно, если тесты независимы (разные страницы, разные аудитории). Если тесты на связанных страницах одной воронки — есть риск интерференции: пользователь увидел вариант B на главной и вариант A на странице услуги, и оценить эффект каждого изменения отдельно невозможно. Для связанных страниц проводите тесты последовательно.

Чем заменить Google Optimize в 2026 году?

Для коммерческих проектов: VWO, Convertize, AB Tasty. Для команд с разработчиками: open-source GrowthBook. Для российских e-commerce: Mindbox A/B (в составе CDP). Для базовых тестов с минимальным бюджетом: кастомная реализация на JavaScript + Яндекс Метрика с трекингом параметров визита.

Как часто нужно проводить A/B-тесты?

В растущих компаниях с достаточным трафиком — непрерывно: один тест завершился, следующий уже стартовал. В нашей практике активные клиенты проводят 2–4 параллельных теста на разных страницах одновременно, что даёт 50–80 завершённых экспериментов в год. В компаниях с малым трафиком — 6–10 тестов в год на ключевых страницах.

Что важнее — рост конверсии или средний чек?

Важнее итоговая выручка, которая равна (трафик × конверсия × средний чек). Рост конверсии на 20% при падении среднего чека на 10% даёт прирост выручки 8%, что меньше, чем рост чека на 15% при стабильной конверсии. Поэтому всегда смотрите на сквозную метрику, а не на конверсию изолированно.

Нужно ли тестировать SEO-страницы?

Да, но осторожно. Поисковики могут негативно отреагировать на динамическую подмену контента, если она расценивается как клоакинг. Безопасный подход: показывать поисковому боту исходную версию, а тест проводить только для пользовательского трафика с UTM-метками или из конкретных каналов. Все профессиональные инструменты A/B-тестирования это поддерживают.

Можно ли тестировать цены?

Технически — да, юридически и этически — с осторожностью. Показ разных цен разным пользователям может квалифицироваться как ценовая дискриминация. Безопасный формат: тестировать формат подачи цены (с НДС/без, в рассрочку/единовременно), скидки или бонусы при одинаковой базовой цене. Тестировать саму цифру цены лучше последовательными изменениями для всех пользователей с измерением эффекта по периодам.